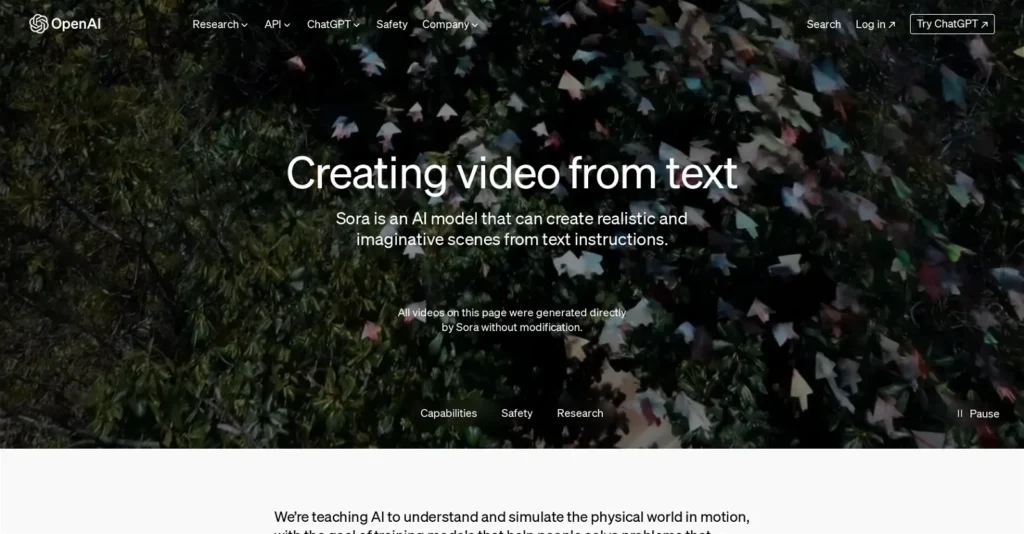

OpenAI vuelve a situarse en la vanguardia de la inteligencia artificial al desarrollar Sora, un impresionante sistema que plasmará cualquier descripción escrita en un video animado de forma realista.

Sora es la última joya de la corona de OpenAI y supone un gran salto respecto a modelos previos como DALL-E o ChatGPT, ya que es capaz de generar dinámicas e interacciones visuales en movimiento. Se trata de una red neural entrenada con billones de pares de texto-video que le permiten comprender instrucciones de manera muy similar a cómo lo haría un humano.

Basta con describir detalles como la apariencia física de personas, objetos y entornos, así como acciones, situaciones y movimientos a recrear, para que Sora los plasme en un video personalizado de hasta 60 segundos de duración. Ya sea una reunión de negocios, una fiesta de cumpleaños o un paisaje natural, este sistema podrá representarlo con una calidad impresionante.

Incluso permite modificar aspectos como la edad, el estilo de vestir o rasgos faciales de los personajes, e influir en factores ambientales del escenario. No obstante, su precisión dependerá de la riqueza de detalles aportados y aún puede tener fallos en algunas recreaciones físicas complejas.

Con su capacidad de materializar descripciones textuales en elaboradas secuencias visuales, Sora marcará un antes y un después en el campo de la generación de contenido mediante IA. Quedará por ver cuándo estará disponible comercialmente y cómo seguirá perfeccionando OpenAI esta tecnología del futuro.